-

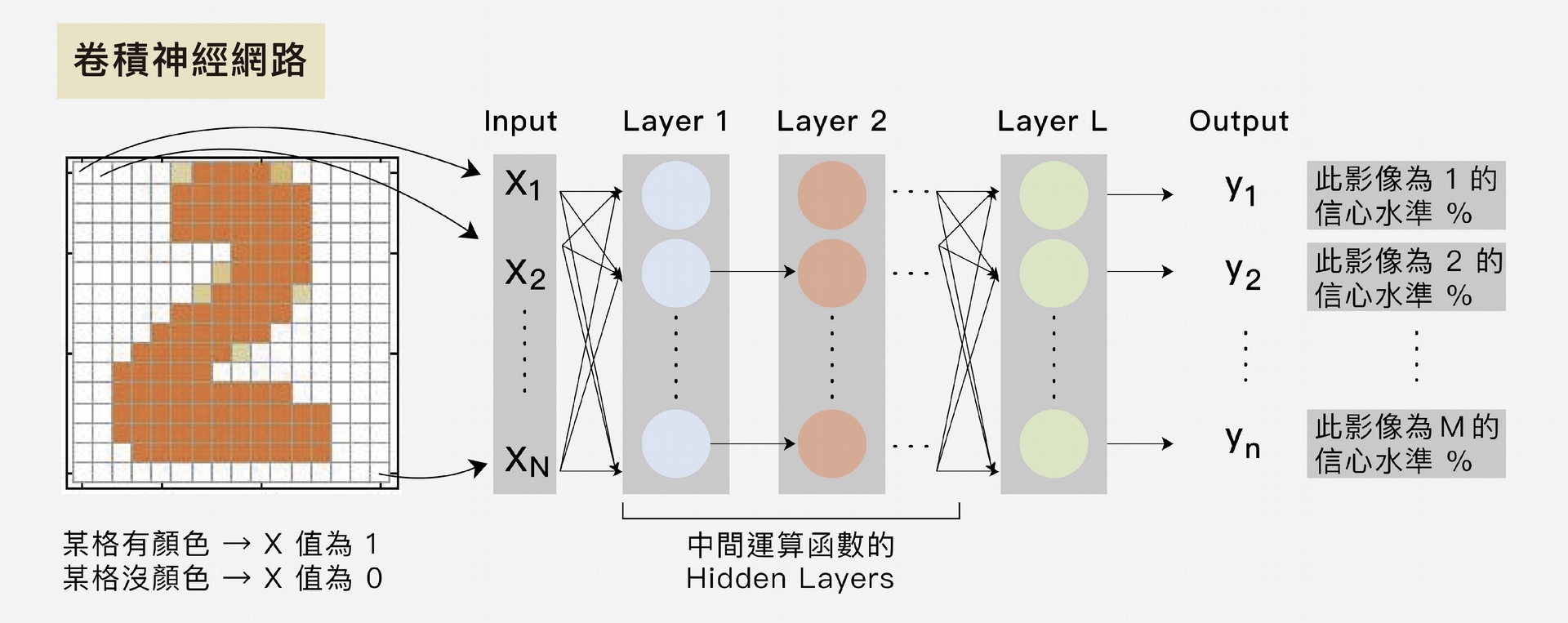

先教電腦定義每個影像的值,再透過神經網路的層層非線性函數運算,判斷這個影像最可能為哪個數字,信心水準比值最高者為答案。 圖│研之有物 (資料來源│李宏毅)

-

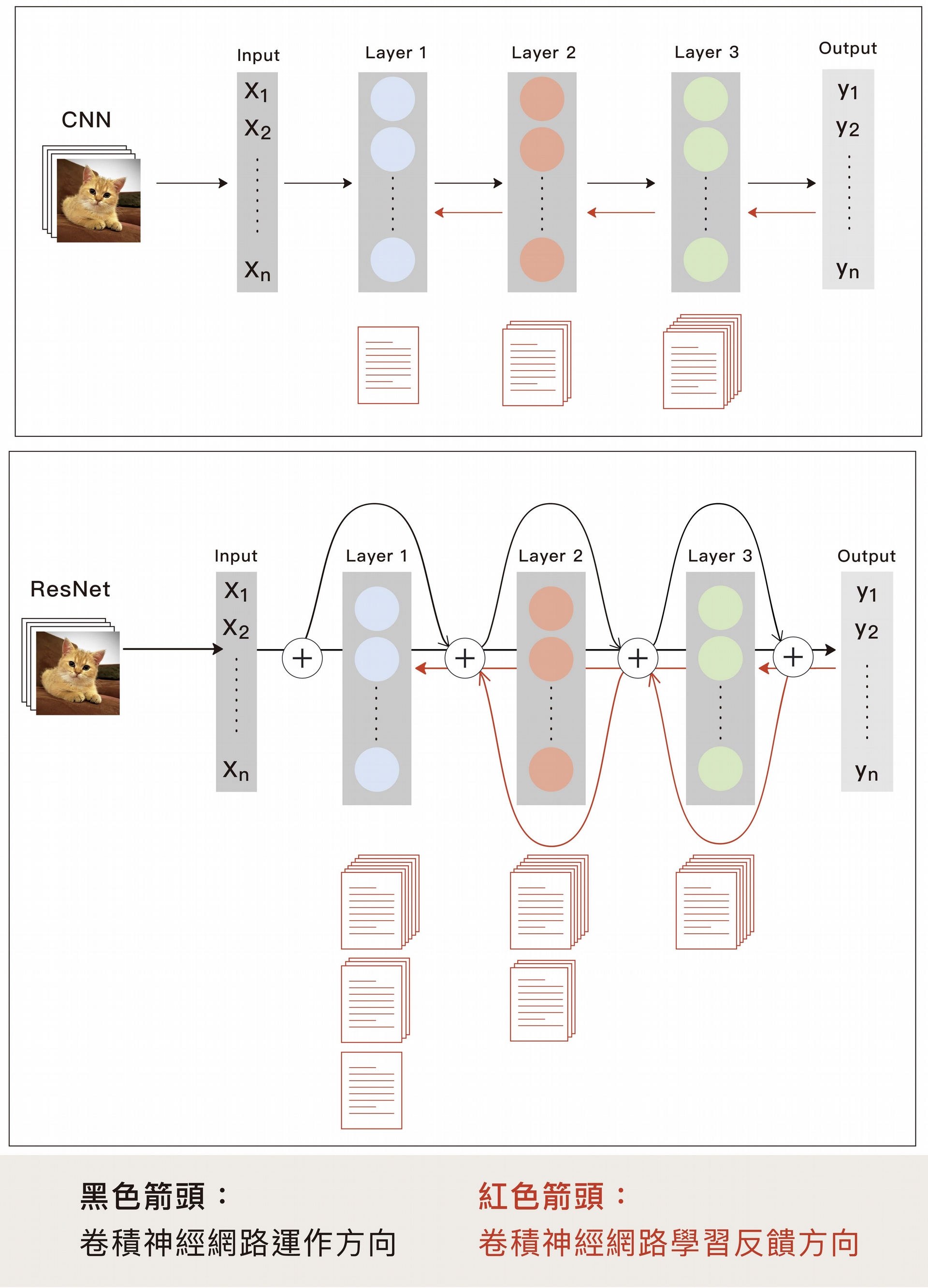

上圖為原始的卷積神經網路 (CNN) ,假設只有三層,在資料回傳的過程中會逐層遞減,稱為梯度消失問題。下圖為改良版 ResNet ,從最後一層開始,每一層都備份,再把備份越過一層「跳級」傳遞,前面網路層就能接收到後面的資訊。 圖│研之有物 (資料來源│王建堯)

-

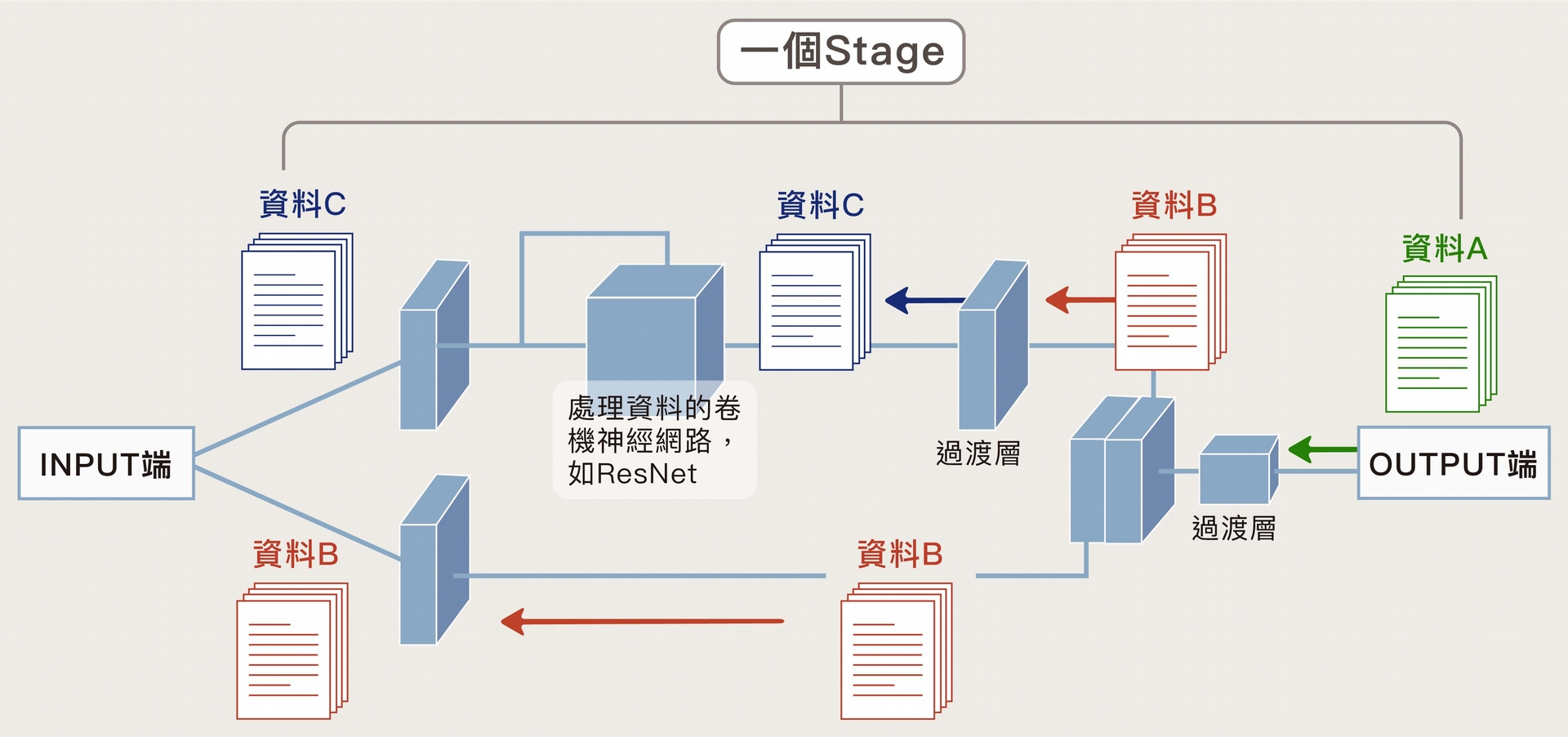

以上為 CSPNet 簡化結構的一部分,三色箭頭代表機器學習過程中,後面的資料如何反饋往前傳。這個設計的重點在於資訊的分流與多了過渡層 (Transtion),讓反饋的學習資訊在分流後產生差異,提高每一網路層參數的利用率,目標是讓機器學到更多樣的東西,提高判斷的精確度。另一方面,因為資料分流的關係,有部分直接往後傳,不經過分析計算,使整個計算量變少,運算速度也因此加快。 圖│研之有物 (資料來源│王建堯)

-

中研院記者會合影。由左到右,義隆電子葉儀皓董事長、中研院周美吟副院長、中研院資訊所廖弘源特聘研究員、中研院資訊所王建堯博士後研究員、科技部前瞻司楊琇雅司長、台大人工智慧研究中心陳信希主任、杜維洲執行長。 圖│研之有物 (中研院秘書處)

Share